Hoaxy a konšpiračné teórie už dávno nie sú iba rozprávky napísané na Telegrame, ktoré si dezinformátori čítajú na dobrú noc. Internet zaplavili posledný rok deepfejkové videá a fotografie, ktoré slúžili na oklamanie, pobavenie aj na posilnenie politických postojov.

Medzi tieto príbehy patria aj mysteriózna Emily Pellegrini, deepfejky boxerky Imane Khelifovej a ďalšie desiatky dievčat, ktoré chceli znudení spolužiaci vidieť bez oblečenia.

Dlho nepriznaná AI influencerka Emily Pellegrini

Príbeh Emily Pellegrini sa začal veľmi tajomne. Mladá 23 ročná Talianka Emily žijúca v Los Angeles bola na svojich sociálnych sieťach čoraz populárnejšia a postupne nazbierala tisícky sledovateľov. Niečo na jej videách však bolo zvláštne. Občas mala iné črty tváre a postava sa jej tiež menila s každou fotografiou či videom. Ľudia sa preto začali pýtať, či nie je výtvorom umelej inteligencie.

Nepýtali sa však všetci. Niektorí muži a ženy jej začali namiesto toho platiť za intímny obsah a ona im na oplátku poskytla fotografie bez oblečenia. So svojimi fanúšikmi komunikovala prostredníctvom komentárov a niektorým boháčom dokonca natoľko pomotala hlavu, že jej ponúkli peniaze, aby s nimi išla na rande.

Špekulácie o tom, či je Emily Pellegrini real alebo nie, sa skončili priznaním. Jej tvorca na svojom instagramovom profile prezradil, že ona aj jej sestra Fiona sú vytvorené pomocou AI.

Aj keď vyšlo najavo, že Emily nie je skutočná, ľudia k nej nestratili náklonnosť a v komentároch jej stále nechávajú odkazy.

Tvorca AI sestier si teraz založil biznis. Predáva kurzy, ktoré majú absolventov naučiť, ako čo najpresvedčivejšie tvoriť s AI.

Celý článok o Emily Pellegrini si môžeš prečítať tu:

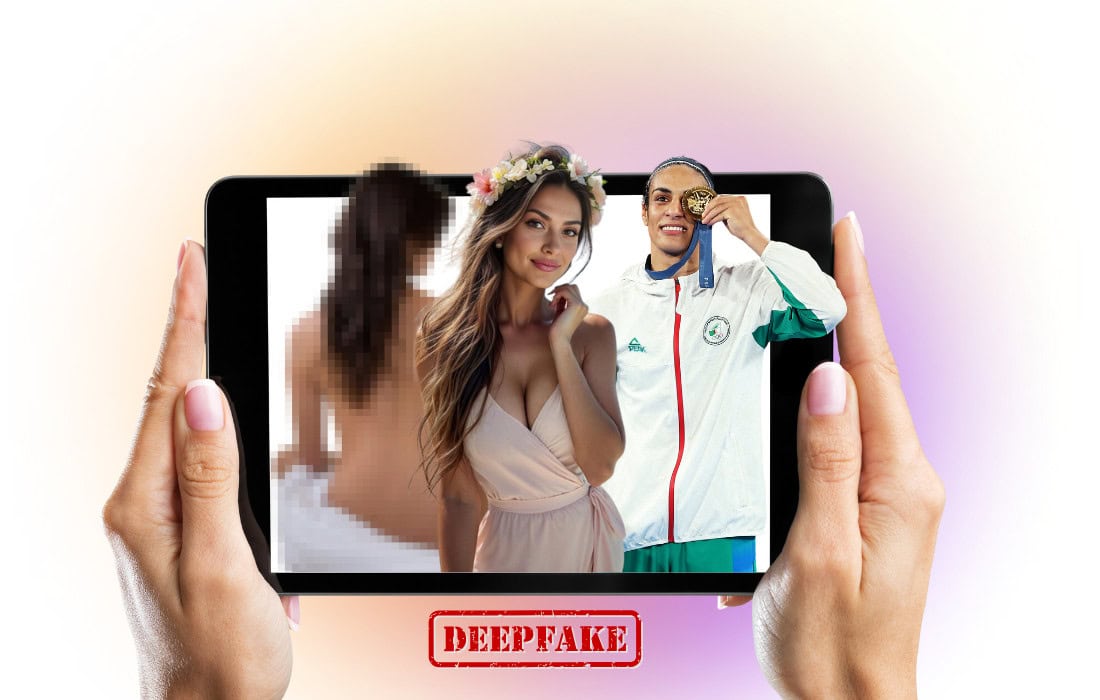

Deepfejková fotografia alžírskej boxerky

Alžírska boxerka Imane Khelifová sa stala terčom dezinformácií a deepfejkových fotografií po tom, čo na Olympijských hrách v Paríži jej súperka Angela Cariniová vzdala zápas už po 46 sekundách. Dôvodom boli mimoriadne silné údery od Khelifovej.

Na sociálnych sieťach začali rôzni známi ľudia, ale aj neznáme profily šíriť dezinformácie, že Khelifová nie je žena, ale muž. Falošné informácie podporili aj deepfejkovými fotografiami, kde má boxerka namiesto ženského tela, mužské.

Fact-checkingová organizácia Newschecker.in však tieto fotografie analyzovala pomocou AI nástrojov a odhalila, že ide o deepfake, pričom na snímkach našla prvky, ktoré tam nemali čo hľadať, ako napríklad náhodnú ruku s kartičkou s nesprávne zoradenými písmenami.

Na konci Olympiády v Paríži povedala Khelifová k celému sporu: „Som plne kvalifikovaná na to, byť súčasťou súťaže. Som žena ako akákoľvek iná žena. Narodila som sa ako žena, žijem ako žena, súťažím ako žena, o tom niet pochýb.“

Celý článok si môžeš prečítať tu:

Nude fotografie vytvorené cez AI

Nahé fotografie stredoškoláčiek sa začali šíriť internetom najmä v zahraničí. Deepfake nudes netvorili cudzí ľudia, ale spolužiaci týchto dievčat. Aplikácie, ktoré im to umožnili, sú voľne dostupné na internete, a preto nestálo medzi ich rozhodnutím a nahými fotografiami ich spolužiačiek, vôbec nič.

Používanie AI ľuďmi, ktorí nepoznajú alebo si neuvedomujú dôsledky tvorby deepfejkových fotografií, môže viesť práve k takýmto situáciám. Tento typ kyberšikany si zažili aj viaceré celebrity, ako napríklad Taylor Swift, ktorej k zastaveniu šírenia falošných fotografií pomohli fanúšičky.

Celý článok si môžeš prečítať tu:

Ako sa nenechať oklamať umelou inteligenciou?

Hoci je AI čoraz sofistikovanejšia a dokáže tvoriť kvalitnejšie deepfejky či vytvárať úplne nové falošné obrázky, stále máš šancu spoznať, či je obsah, na ktorý sa pozeráš real, alebo fake.

Ako?

Všímaj si detaily.

Fotografie vytvorené AI môžu obsahovať neprirodzené detaily, ako sú asymetrické oči, nepresné tieňovanie, nezvyčajne spojené časti tváre, ruky obsahujúce viac ako 5 prstov, náhodne vytŕčajúce končatiny na skupinových fotografiách.

Pri videách vytvorených AI sa môžu vyskytnúť problémy so synchronizáciou pier a zvuku alebo neprirodzeným pohybom hlavy, či iných častí tela.

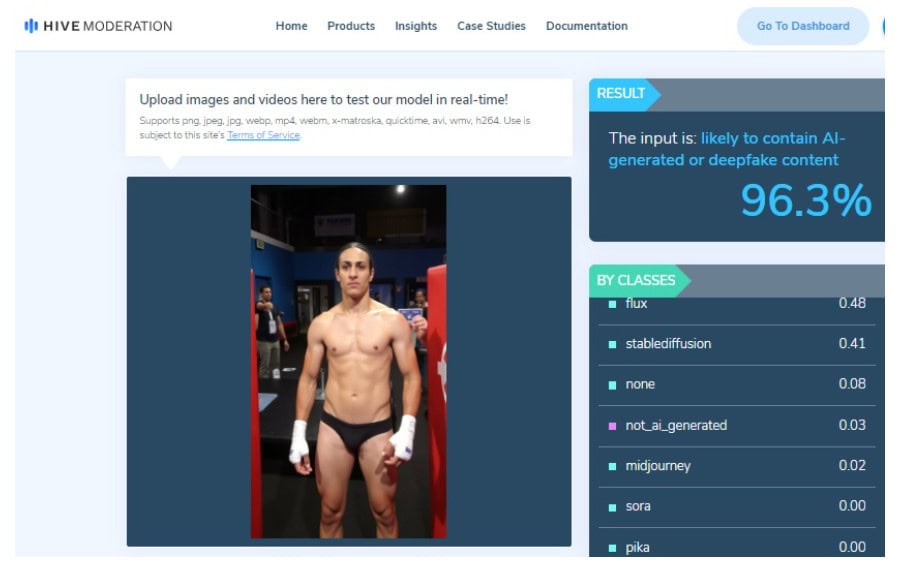

Použi nástroje na detekciu AI.

Existujú nástroje a platformy na rozpoznanie AI obsahu, ako napríklad Deepware Scanner na odhaľovanie deepfake videí, či TrueMedia, ktoré ti pomôžu odhaliť, či bol obsah vytvorený pomocou umelej inteligencie, alebo nie.

Nespoliehaj sa na ne ale stopercentne, tvorcovia fejkov sú vždy o krok vpred pred tými, ktorí sa ich snažia odhaľovať. Najsilnejším detektorom falošných videí, fotografií a informácií tak ostáva tvoje kritické myslenie.

Vyskúšaj spätné vyhľadávanie obrázkov.

Pomôcť si vieš aj spätným vyhľadávaním obrázkov cez Google Images alebo TinEye.

Over si zdroj.

Deepfejk môže na prvý pohľad vyzerať veľmi realisticky, preto je dobré overiť si aj samotný zdroj, odkiaľ bola informácia prvýkrát publikovaná. Skús si dohľadať, kto ju vypustil do sveta. Je to dôveryhodná osoba alebo nejaký anonymný profil s takýmto menom: tvojtatko58764, ktorý má 3 sledovateľov a on sám sleduje iba zopár profilov?

Nezabudni ani na klasické overenie informácie z viacerých zdrojov. Napíš si do vyhľadávača tému, ktorej pravdivosť sa snažíš overiť. Môže byť, že tento (deep)fake už pred tebou odhalil niekto iný a v tom prípade ti stačí prečítať si, kto sa snažil komu spraviť zle.

Zdroj titulnej fotografie: Koláž Zmudri G (IG profil Emily Pellegrini, gettyimages)